Crawl Budget Maksimal: Strategi Cerdas Website Besar untuk Efisiensi Indexing

Mengelola crawl budget mungkin terdengar teknis, tapi ini menentukan seberapa cepat konten website kamu muncul di hasil pencarian. Crawl budget adalah “jatah kunjungan” bot mesin pencari, jika tidak dimanfaatkan dengan cerdas, konten baru bisa tertunda untuk diindeks, halaman lama tetap sering dikunjungi, dan peluang trafik hilang begitu saja.

Website besar punya strategi untuk memaksimalkan setiap kunjungan bot, mulai dari kontrol robots.txt, sitemap, hingga arsitektur informasi yang efisien. Di artikel ini, kami akan membahas cara mengelola crawl budget secara efektif, dengan tips dan praktik yang bisa langsung diterapkan agar setiap konten memiliki peluang terbaik untuk muncul lebih cepat di mesin pencari.

Kontrol Crawl & Index

Mengelola crawl budget efektif berarti memastikan bot mesin pencari tahu halaman mana yang harus dikunjungi dan mana yang bisa dilewati. Dengan pengaturan yang tepat, setiap jatah crawl digunakan seefisien mungkin, sehingga halaman penting lebih cepat terindeks. Berikut beberapa langkah kunci yang bisa diterapkan:

- Robots.txt & Meta Robots: file robots.txt dan meta robots memungkinkan kamu menentukan halaman mana yang boleh diindeks dan mana yang diblokir. Dengan ini, bot tidak membuang waktu pada halaman yang kurang relevan.

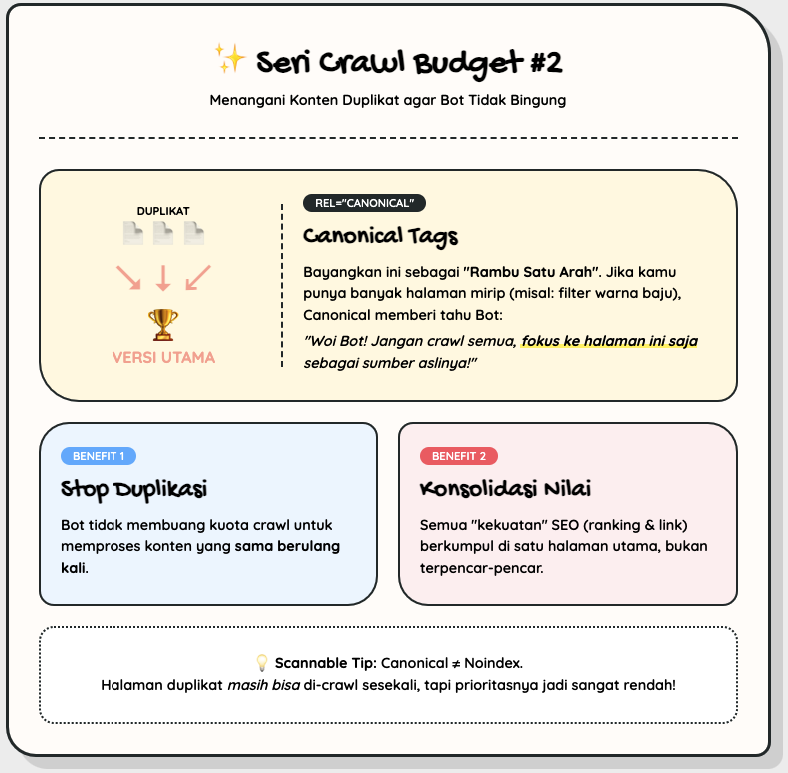

- Canonical Tags: membantu mencegah duplikat konten. Bot diarahkan ke versi utama halaman, sehingga semua perhatian crawl fokus ke halaman yang benar-benar penting.

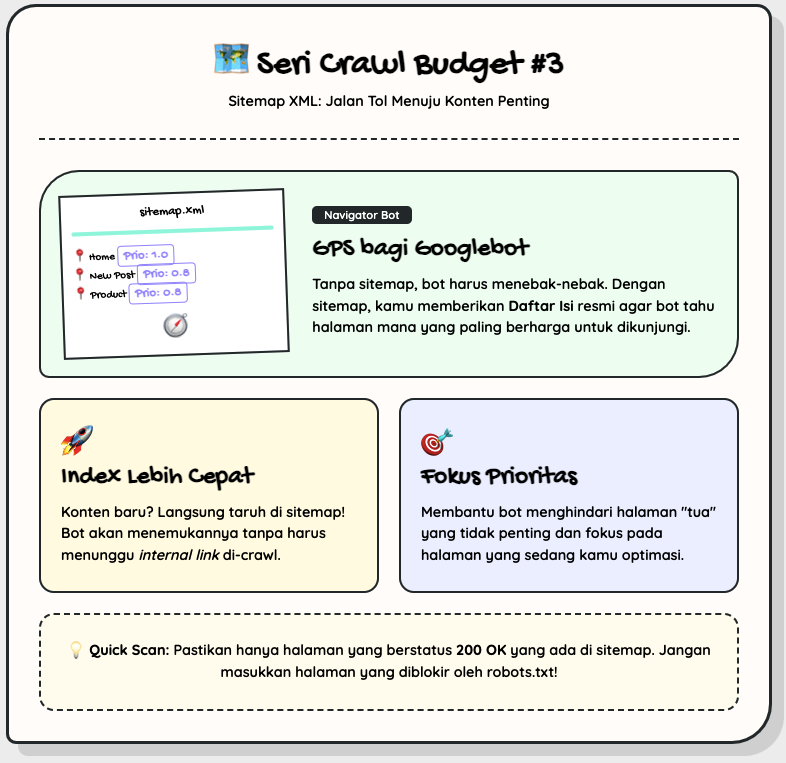

- Sitemap XML: memberi tahu bot halaman mana yang prioritas. Dengan ini, konten terbaru dan paling penting lebih cepat terindeks, menghindari keterlambatan dalam hasil pencarian.

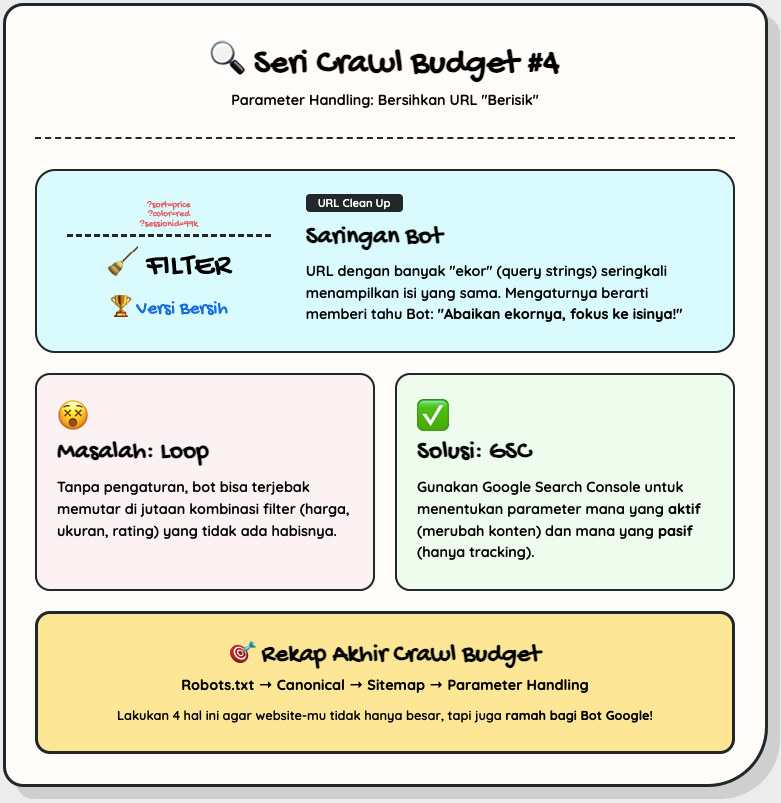

- Parameter Handling: URL dengan query strings atau filter sering membuat bot mengunjungi versi yang sama berulang kali. Mengatur parameter dengan benar menghemat crawl budget dan menjaga efisiensi indeksasi.

Misal blog portofolio atau artikel niche: pastikan halaman utama, kategori, dan konten terbaru mudah diakses bot agar setiap halaman mendapat perhatian yang layak.

Tanpa kontrol yang tepat dan hosting cepat, crawl budget bisa habis sia-sia dan halaman penting tidak terindeks. Web Hosting DomaiNesia menjamin server cepat dan stabil, sehingga setiap konfigurasi crawl & index bekerja optimal dan risiko kehilangan indexing bisa dihindari.

Analisis Log & Monitoring

Mengelola crawl budget tidak berhenti pada pengaturan robots atau sitemap saja. Penting juga untuk memantau bagaimana bot benar-benar merayapi website, sehingga kamu bisa mengetahui halaman mana yang mendapat perhatian, mana yang terlewat, dan apakah ada jatah crawl yang terbuang. Beberapa langkah berikut membantu melakukan analisis dan monitoring dengan tepat:

- Log Server: menganalisis log server menunjukkan pola kunjungan bot secara langsung. Dari sini, kamu bisa tahu halaman mana yang sering dikunjungi, waktu kunjungan, dan error yang muncul saat bot mencoba mengakses konten.

- Google Search Console: tools ini membantu memantau halaman yang sudah terindeks, menampilkan error, dan memberi insight tentang bagaimana Googlebot merayapi website. Dengan data ini, kamu bisa menyesuaikan strategi crawl agar lebih efisien.

- Screaming Frog / Log Analyzer: tools pihak ketiga seperti Screaming Frog atau log analyzer sederhana bisa memvisualisasikan traffic bot, menunjukkan halaman prioritas dan halaman yang terabaikan. Ini penting untuk memastikan crawl budget dipakai pada halaman yang benar-benar penting.

- Data-driven Decision: dari hasil log dan monitoring, kamu bisa menentukan prioritas halaman, memperbaiki struktur internal linking, dan menyesuaikan sitemap sehingga bot menghabiskan waktunya secara optimal.

Tanpa pemantauan yang tepat, bot bisa membuang jatah crawl pada halaman tidak penting atau error, membuat halaman prioritas terlambat terindeks. Hosting lambat atau terbatas memperparah masalah ini. Dengan Web Hosting DomaiNesia, log bisa diakses cepat, monitoring berjalan lancar, dan setiap crawl bot digunakan seefisien mungkin sehingga risiko kehilangan indexing minimal.

Arsitektur Informasi untuk Efisiensi Indexing

Selain kontrol crawl dan monitoring, cara website menyusun informasi juga berdampak besar pada efisiensi crawl budget. Struktur yang jelas dan rapi memudahkan bot menemukan halaman penting tanpa membuang waktu pada konten yang kurang prioritas. Berikut beberapa praktik utama yang bisa diterapkan:

- Struktur URL Bersih: gunakan URL yang deskriptif dan konsisten, tanpa karakter acak atau panjang berlebihan. Bot lebih mudah memahami hierarki konten dan mengalokasikan jatah crawl ke halaman penting.

- Hierarki Konten & Internal Linking: susun halaman utama, kategori, dan sub halaman dengan jelas. Internal linking yang baik membantu bot menavigasi website, memastikan setiap halaman prioritas mendapatkan perhatian yang layak.

- Prioritaskan Konten Fresh & High-Value: halaman baru atau konten yang paling penting sebaiknya lebih mudah diakses melalui menu utama atau sitemap. Bot cenderung mengunjungi halaman prioritas lebih sering jika strukturnya jelas.

- Redirect & Broken Link Management: hindari redirect loop atau broken link yang bisa menghabiskan jatah crawl. Periksa dan perbaiki link secara rutin agar crawl budget digunakan secara optimal.

Dengan arsitektur informasi yang tersusun rapi, bot bisa fokus pada halaman yang paling penting, mempercepat indeksasi konten baru, dan mengurangi waktu terbuangnya crawl budget. Jika struktur kurang jelas atau hosting lambat, halaman prioritas bisa terlewat, konten baru tertunda muncul di hasil pencarian, dan peluang trafik hilang. Dengan Web Hosting DomaiNesia, server cepat dan stabil memastikan setiap halaman diakses bot dengan optimal, sehingga strategi struktur website kamu benar-benar efektif.

Web Hosting DomaiNesia, Crawl Lebih Efisien!

Praktik & Tips Tambahan

Selain kontrol crawl, monitoring log, dan arsitektur informasi, ada beberapa praktik tambahan yang bisa membuat setiap jatah crawl bot lebih efektif. Langkah-langkah ini membantu memastikan halaman penting cepat terindeks dan crawl budget tidak terbuang sia-sia:

- Periksa Broken Links & Redirect Loop: link yang rusak atau redirect loop bisa membuat bot membuang waktu mengunjungi halaman yang tidak ada atau terus diarahkan. Misalnya, halaman artikel lama yang sudah dihapus tapi masih ada link internal bisa membuat bot bolak-balik sia-sia. Rutin cek dan perbaiki link untuk memastikan bot fokus ke konten yang benar-benar relevan.

- Update Sitemap & Ping Search Engine: sitemap yang up-to-date membantu bot mengetahui halaman baru atau konten yang diperbarui. Mengirim notifikasi (ping) ke mesin pencari memastikan bot segera mengunjungi halaman tersebut. Ini sangat penting untuk konten terbaru agar cepat muncul di hasil pencarian.

- Prioritaskan Konten High-Value: tidak semua halaman sama pentingnya. Fokuskan crawl bot pada konten yang memberikan nilai tinggi, seperti artikel populer atau halaman portofolio. Letakkan halaman ini di menu utama atau hubungkan dengan internal link strategis agar bot lebih mudah menemukannya.

- Kontrol Frekuensi Update Konten: bot cenderung sering mengunjungi halaman yang diperbarui secara rutin. Jika halaman minor atau halaman kurang penting diperbarui terlalu sering, bot bisa menghabiskan jatah crawl pada halaman itu. Atur update dengan bijak agar halaman prioritas mendapat perhatian maksimal.

- Manfaatkan Tools Analisis: gunakan Google Search Console, Screaming Frog, atau log analyzer sederhana untuk melihat halaman mana yang sering dikunjungi bot, mana yang terlewat, dan error apa yang muncul. Data ini membantu kamu membuat keputusan berbasis informasi, bukan hanya tebakan.

Jika praktik tambahan ini diabaikan, bahkan website yang terlihat terstruktur bisa kehilangan kesempatan agar halaman penting terindeks, konten baru terlambat muncul, dan potensi trafik hilang. Hosting yang lambat hanya memperparah masalah. Web Hosting DomaiNesia hadir dengan server handal dan responsif, memastikan setiap halaman mendapat perhatian bot sesuai prioritas.

Jangan Biarkan Kontenmu Terbuang Sia-Sia

Sekarang kamu sudah paham bagaimana website besar mengelola crawl budget: dari kontrol crawl & index, monitoring log, hingga struktur informasi yang efisien dan praktik tambahan untuk memaksimalkan indexing. Setiap langkah ini penting untuk memastikan halaman penting cepat terindeks, konten baru muncul tepat waktu, dan peluang trafik tidak hilang.

Bayangkan jika semua upaya membuat konten, menulis artikel, atau membangun portofolio terbuang sia-sia hanya karena hosting lambat atau konfigurasi crawl tidak optimal. Risiko kehilangan indexing bisa merugikan pertumbuhan website, menunda peluang exposure, dan mengurangi trafik yang seharusnya datang.

Risiko konten tidak terindeks bisa merugikan, tapi dengan Web Hosting DomaiNesia, setiap halaman diakses bot secara cepat dan efisien. Crawl budget digunakan secara optimal, sehingga konten baru tidak tertunda dan peluang trafik tidak hilang. Optimalkan sekarang sebelum kesempatan lewat begitu saja.

Setiap hari tanpa hosting cepat = potensi trafik hilang. Mulai dengan DomaiNesia hari ini.