Tutorial Ollama GUI: Cara Menggunakan Ollama + Open WebUI

Halo DomaiNesians! Jika kalian tertarik untuk mengeksplorasi teknologi Large Language Model (LLM) seperti Ollama, maka artikel kali ini sangat cocok dengan kebutuhan kalian.

Secara default, Ollama berjalan melalui antarmuka baris perintah (CLI). Tapi agar lebih mudah digunakan, terutama oleh pengguna non-teknis atau tim yang ingin kolaborasi, kita bisa menghubungkannya dengan Open WebUI yaitu sebuah antarmuka grafis (GUI) yang intuitif dan ramah pengguna.

Nah, dalam tutorial kali ini, kita akan membahas cara mudah untuk menginstal Ollama dan Open WebUI (menggunakan template VPS), menjelajahi fitur-fitur di dashboard, menjalankan model, menyesuaikan output, hingga menggunakan fitur kolaborasi dan model multimodal. Jadi, kamu bisa fokus bereksperimen tanpa harus repot mengetik perintah yang kompleks.

Apa Itu Ollama GUI?

Sebelum masuk ke tahap instalasi dan penggunaannya, yuk kita kenalan terlebih dahulu dengan apa itu Ollama GUI.

Secara sederhana, Ollama adalah platform yang dirancang untuk menjalankan Large Language Models (LLM) seperti Llama, Mistral, Vicuna, dan lain-lain. Biasanya, Ollama dijalankan melalui command-line interface (CLI), yaitu antarmuka berbasis teks yang mengharuskan kita mengetik perintah secara manual di terminal.

Bagi kalian pengguna teknis, CLI mungkin sudah akrab dan menjadi makanan kalian sehari-hari. Namun, bagaimana kalau kamu bukan pengguna teknis yang tidak terbiasa dengan CLI atau lebih nyaman bekerja secara visual? Nah, di sinilah Ollama GUI akan berperan membantu kalian.

Ollama GUI adalah versi antarmuka grafis dari Ollama, yang memungkinkan kita berinteraksi dengan model bahasa besar melalui tampilan visual seperti chat box, tombol, dan panel navigasi tanpa perlu mengetik baris-baris perintah. Ollama GUI sendiri memanfaatkan Open WebUI, yaitu tool open-source yang berfungsi sebagai wajah depan (front-end) untuk Ollama.

Dengan menggunakan Open WebUI tersebut, kita bisa melakukan beberapa hal, yaitu:

- Mengirim prompt ke model AI (Artificial Intelligence) seperti mengobrol

- Melihat output model dalam format yang mudah dibaca

- Mengelola model-model AI yang digunakan

- Bekerja kolaboratif bersama tim

- Mengakses dan menganalisis dokumen atau web langsung dari dashboard

Dengan antarmuka visual yang mirip ChatGPT, kamu bisa langsung mengetik pertanyaan, mengganti model dengan satu klik, atau mengunggah dokumen untuk dianalisis. Semua bisa dilakukan lewat tampilan dashboard yang intuitif.

Persiapan Setup Ollama dengan Open WebUI

Cara praktis untuk menjalankan Ollama dengan tampilan antarmuka grafis adalah menggunakan VPS yang kamu kelola sendiri. Nah, untuk kalian para pengguna Cloud VPS DomaiNesia, kalian bisa memasang Docker, Ollama, Open WebUI, dan model Llama 3.1 secara manual melalui terminal.

Berikut alur persiapan setup Ollama dengan Open WebUI yang perlu kamu lakukan:

- Gunakan VPS dengan spesifikasi minimal 4 vCPU, 16 GB RAM, dan 100 GB storage.

- Install Docker dan Docker Compose.

- Pasang Ollama dengan perintah yang sesuai dari dokumentasinya.

- Jalankan Open WebUI sebagai frontend-nya.

Tutorial Cara Menggunakan Ollama dengan Open WebUI

Pada bagian ini, kita akan belajar bagaimana cara menggunakan Ollama dengan Open WebUI dengan memahami apa saja fitur-fitur Open WebUI, mulai dari navigasi dashboard hingga bagaimana cara bekerja dengan model multimodal.

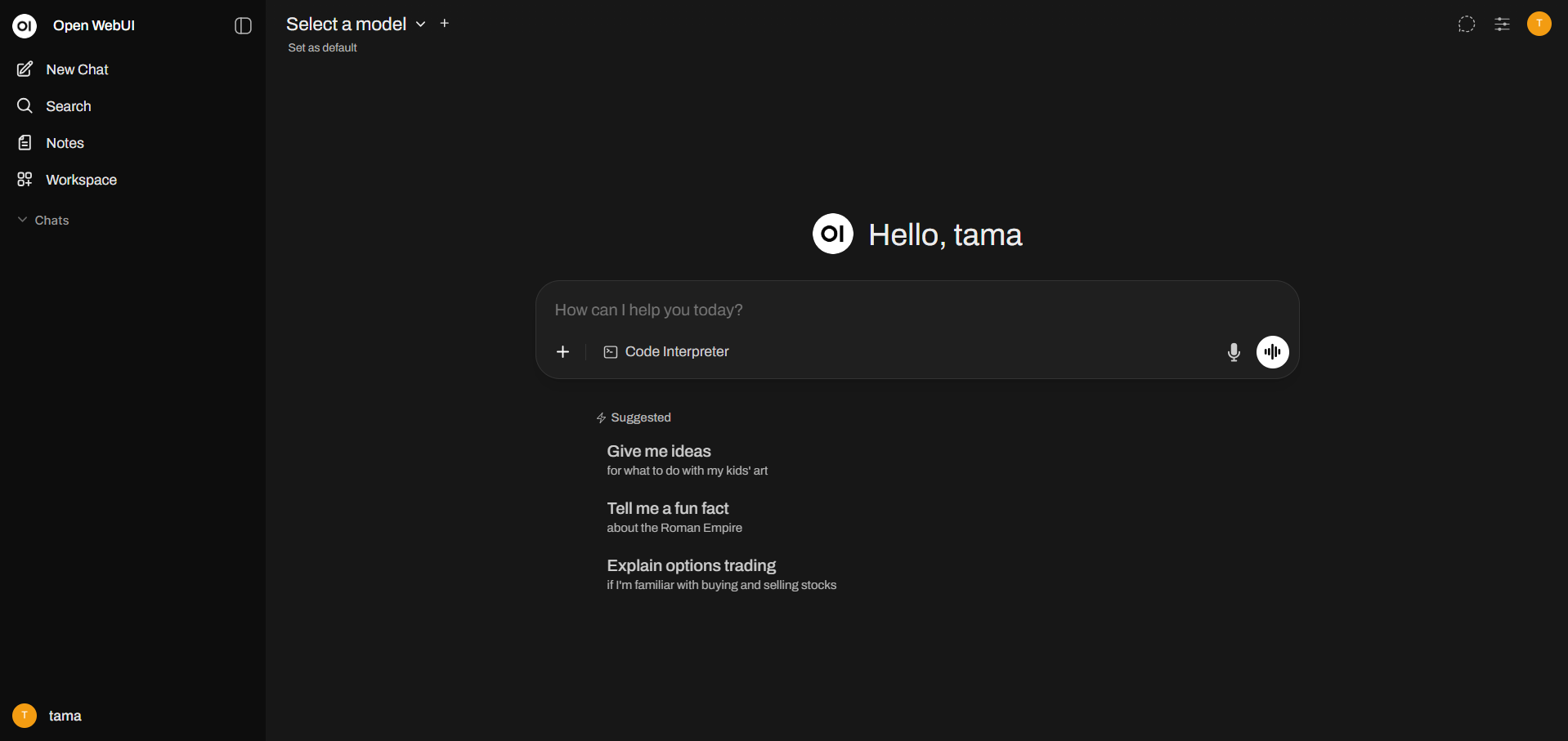

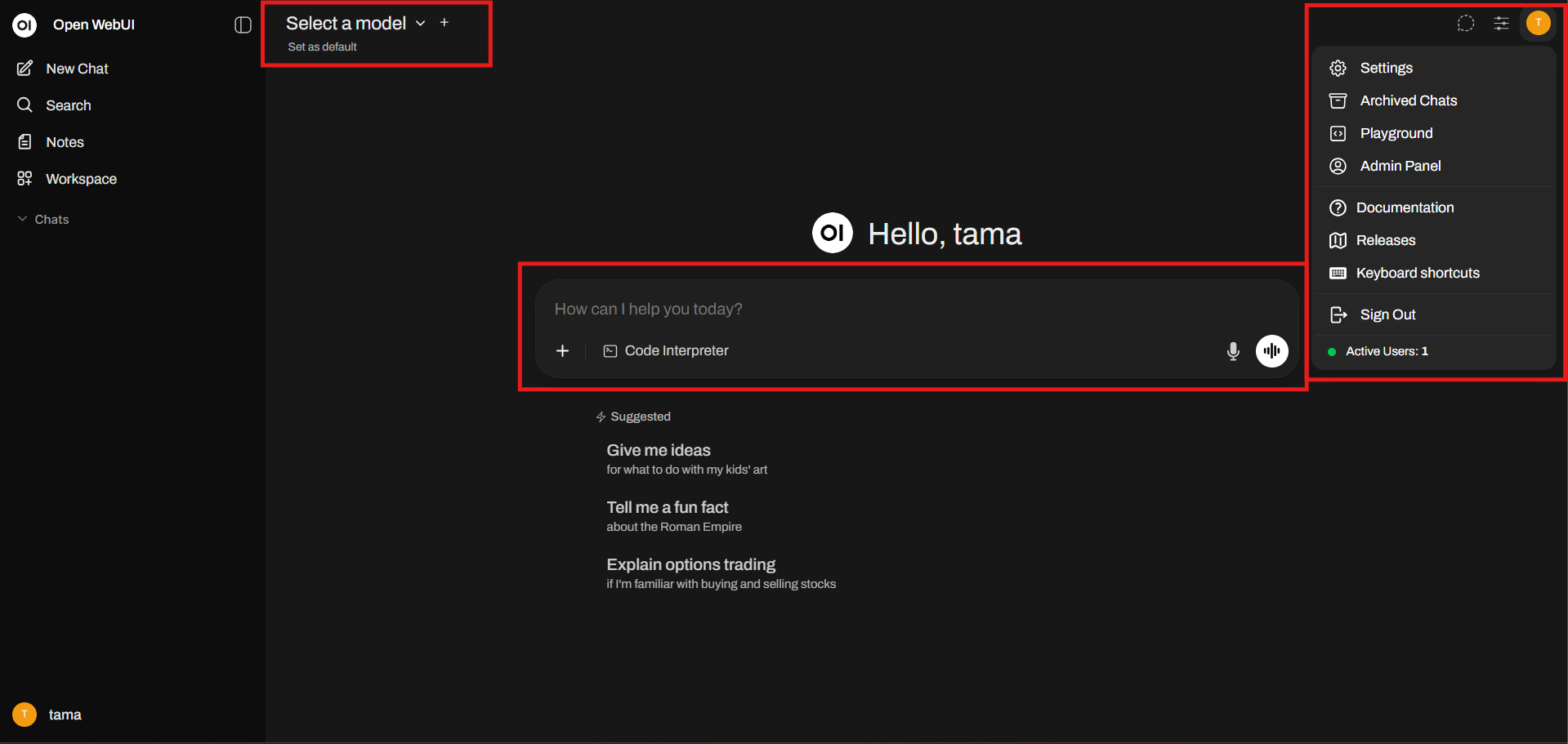

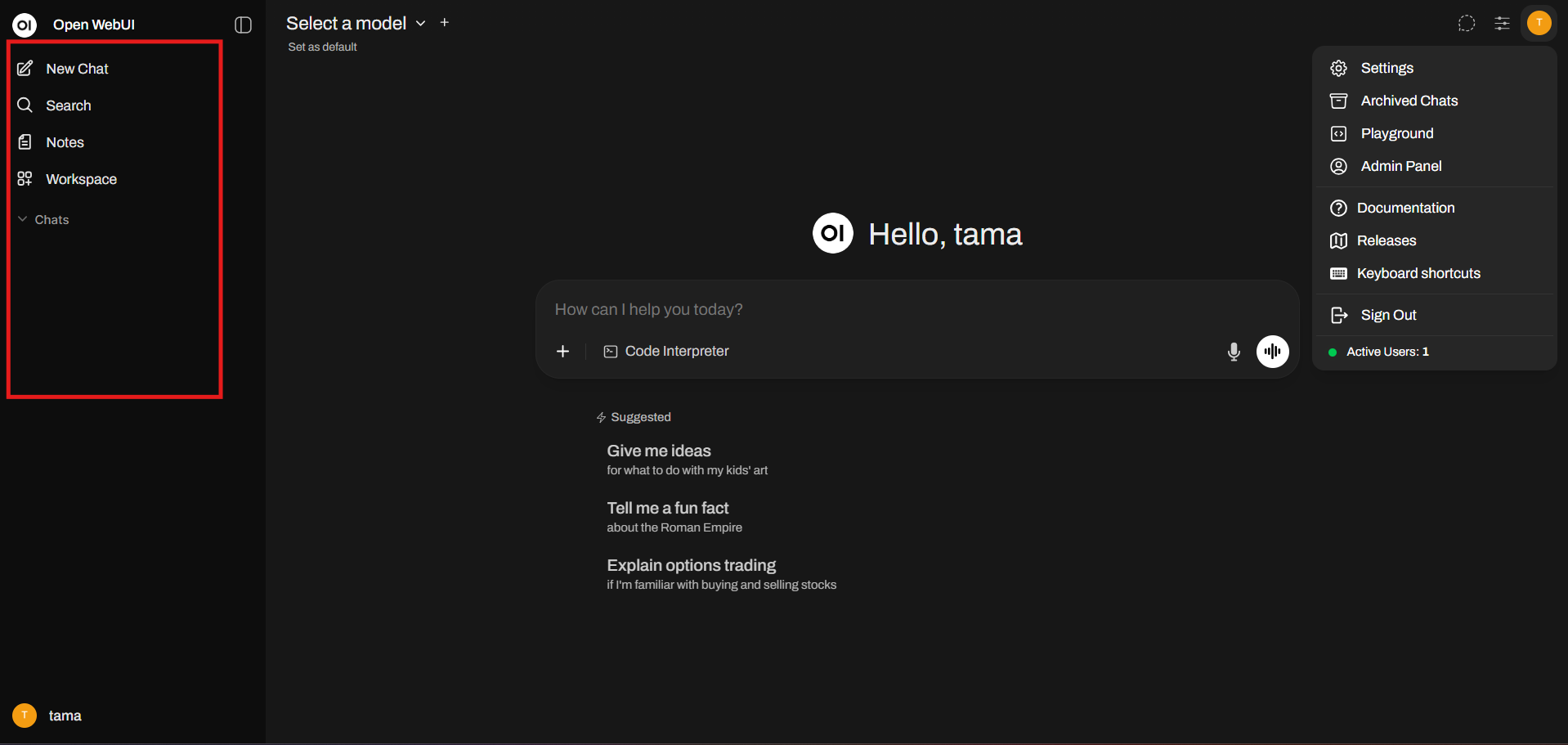

1. Mengenal Dashboard Open WebUI

Setelah berhasil masuk, kamu akan melihat dashboard Open WebUI. Tampilan dashboard Open WebUI sangat ramah pengguna, bahkan untuk kamu yang masih pemula. Tapi, jika kamu sudah pernah menggunakan ChatGPT, maka kamu akan lebih mudah memahaminya karena tampilannya cukup mirip.

Struktur dashboard Open WebUI terbagi menjadi dua bagian yaitu:

a. Data Pane (Area Utama Percakapan)

Di sini, kamu bisa mengetik prompt, mengirim file, atau menggunakan perintah suara. Di pojok kiri atas, kamu bisa memilih model yang tersedia atau mendownloadnya dari library Ollama. Sementara di pojok kanan atas, tersedia opsi pengaturan model, akses admin panel, dan pengaturan akun.

b. Sidebar Kiri

Di sini kamu bisa memulai obrolan (threads) baru atau melanjutkan thread sebelumnya. Selain itu, kamu juga bisa menyematkan (pin), mengarsipkan, membagikan, atau menghapus percakapan. Ada juga panel admin workspace yang memungkinkan kamu untuk membuat model khusus berdasarkan pengetahuan, prompt, dan fungsi tertentu.

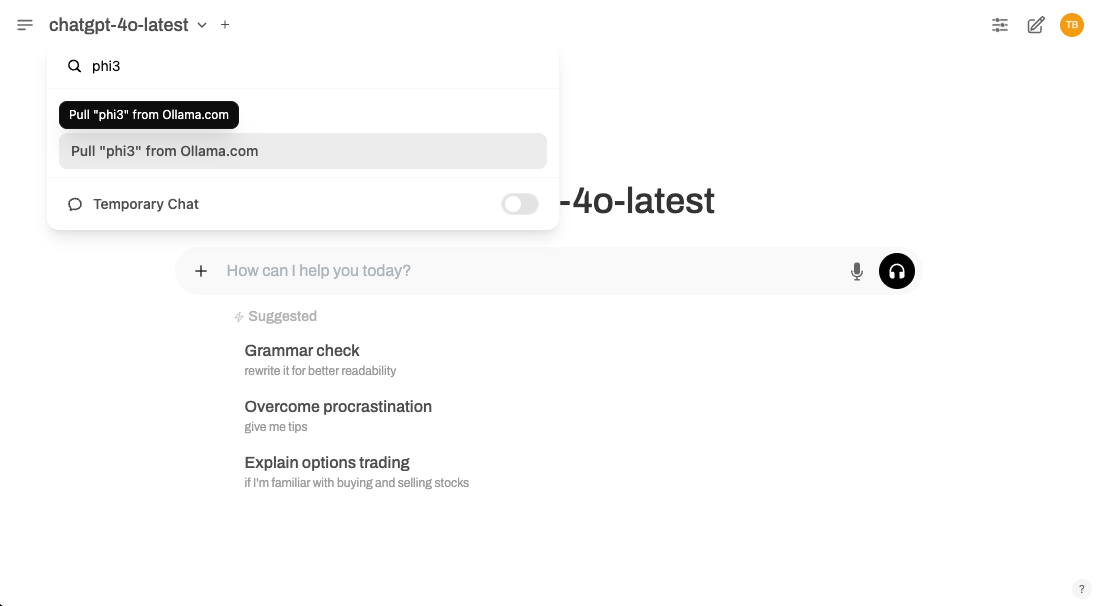

2. Memilih dan Menjalankan Model

Model seperti Llama 3.1 biasanya sudah tersedia setelah instalasi. Namun, kamu bisa mendownload model lain dari panel pencarian di pojok kiri atas data pane. Caranya:

a. Ketik nama model yang ingin kamu tambahkan.

b. Klik tombol Pull [nama_model] from Ollama.com.

Jika kamu masih bingung harus pakai model yang mana, kamu bisa mengunjungi katalog model resmi dari Ollama. Di sana kamu bisa mendapatkan informasi dari setiap model beserta deskripsi dan rekomendasi penggunaan dari masing-masing model.

Beberapa model yang sering digunakan antara lain:

- Mistral: efisien untuk tugas penerjemahan dan merangkum teks panjang.

- Code Llama: cocok untuk kamu yang ingin menghasilkan kode atau membantu tugas pemrograman.

- LLaVA: bisa memahami dan menjawab berdasarkan input gambar.

Untuk memulai percakapan, klik New Chat, pilih model, ketik prompt, lalu model akan menampilkan respons. Jika hasil tidak sesuai harapan, kalian bisa meminta regenerasi atau memberikan umpan balik.

Hal menarik lainnya dari Open Web UI yaitu, kamu bisa mengganti model yang digunakan saat percakapan masih berjalan. Misalnya memulai dengan Llama dan beralih ke Vicuna dalam sesi yang sama untuk melihat perbedaan

Selain itu, Open WebUI juga memungkinkan penggunaan beberapa model sekaligus. Hasilnya akan ditampilkan berdampingan sehingga kamu bisa membandingkan hasilnya dengan lebih mudah.

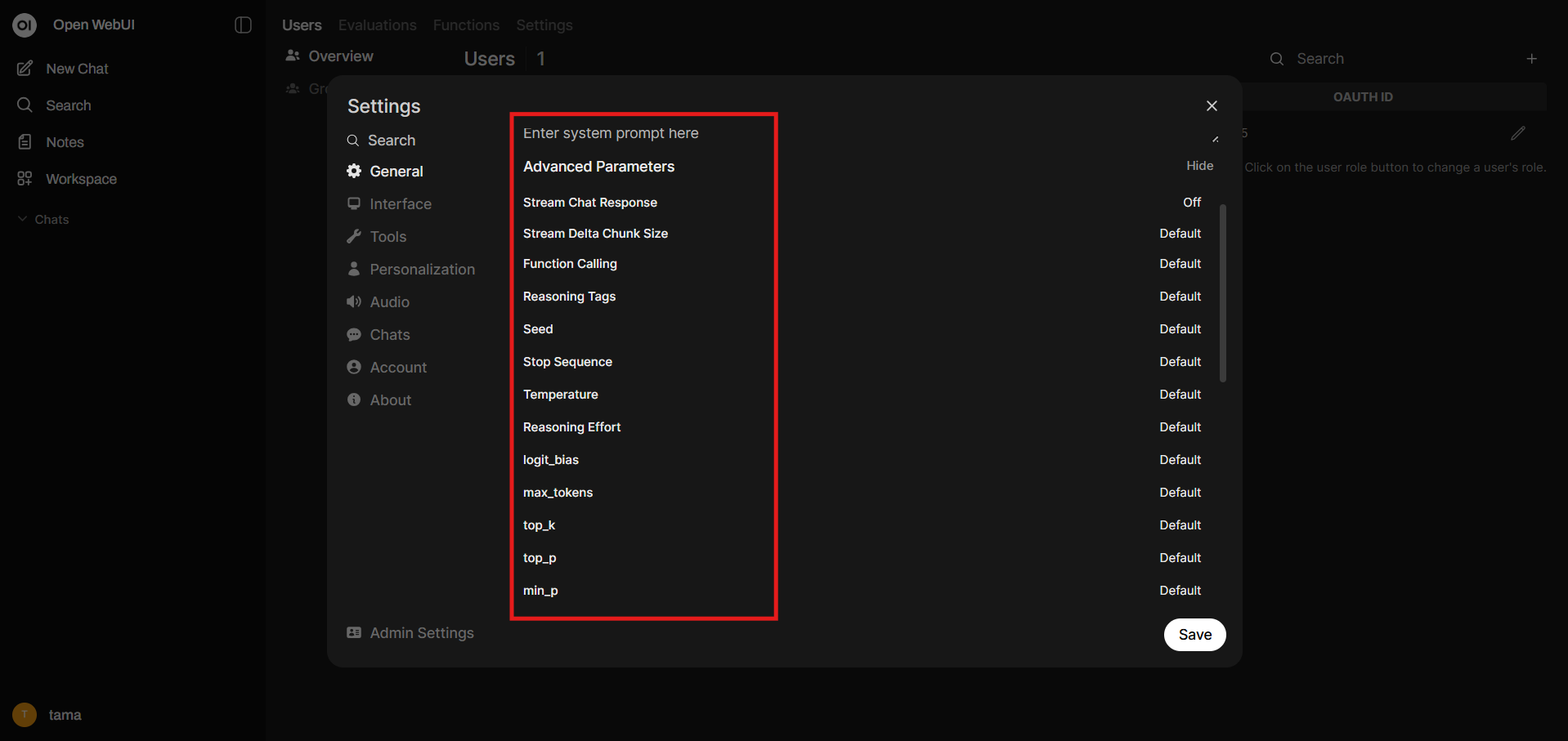

3. Kustomisasi Output Model

Dengan menyesuaikan respon model, kamu bisa mengarahkan cara model menanggapi prompt secara lebih spesifik. Kamu bisa mengarahkannya untuk menggunakan nada tertentu, gaya penulisan tertentu, atau performa yang lebih efisien.

Caranya, klik tombol Chat Control untuk membuka pengaturan parameter yang bisa kamu sesuaikan, seperti:

- Stream Chat Response: menampilkan jawaban secara real-time, bukan menunggu semua jawaban selesai dibuat.

- Seed: membuat output konsisten untuk prompt yang sama.

- Stop Sequence: menentukan kata atau frasa yang akan menghentikan keluaran model secara alami, misalnya di akhir kalimat.

- Temperature: mengatur tingkat kreativitas model dalam menjawab prompt. Semakin rendah nilainya, jawaban akan lebih fokus dan dapat diprediksI. Semakin tinggi, respons akan jadi lebih kreatif.

- Mirostat: menjaga respons tetap konsisten, khususnya saat kamu meminta penjelasan yang panjang.

- Frequency Penalty: mengurangi pengulangan kata agar hasil respon lebih bervariasi.

- Context Length: mengatur seberapa banyak konteks atau informasi yang diingat model dalam satu sesi obrolan.

- Max Tokens (num_predict): membatasi panjang respon agar jawaban tidak terlalu panjang, jadi lebih to the point

Selain itu, masih di menu yang sama, kamu juga bisa mengatur bagian Valves (fitur atau tools tambahan) serta System Prompt (yang mengatur gaya dan karakter model secara default).

Kamu juga bisa bereksperimen dengan mode Playground di pojok kanan atas. Di sini ada dua tab yaitu:

a. Tab Chat untuk simulasi percakapan. Di sini kamu bisa menggunakan fitur-fitur:

- System Instructions: menentukan peran model (misal: “Anda bertindak sebagai penasihat keuangan”)

- User Message: prompt atau pertanyaan langsung yang ingin kamu ajukan.

b. Tab Completion untuk menyuruh model melanjutkan kalimat atau paragraf tertentu. Misalnya: “Machine learning adalah…” dan model akan menyelesaikannya.

4. Mengintegrasikan Dokumen dan Halaman Web

Ollama dan Open WebUI juga mendukung fitur retrieval-augmented generation (RAG), yaitu metode untuk memperkaya jawaban model dengan informasi real-time dari dokumen atau halaman web.

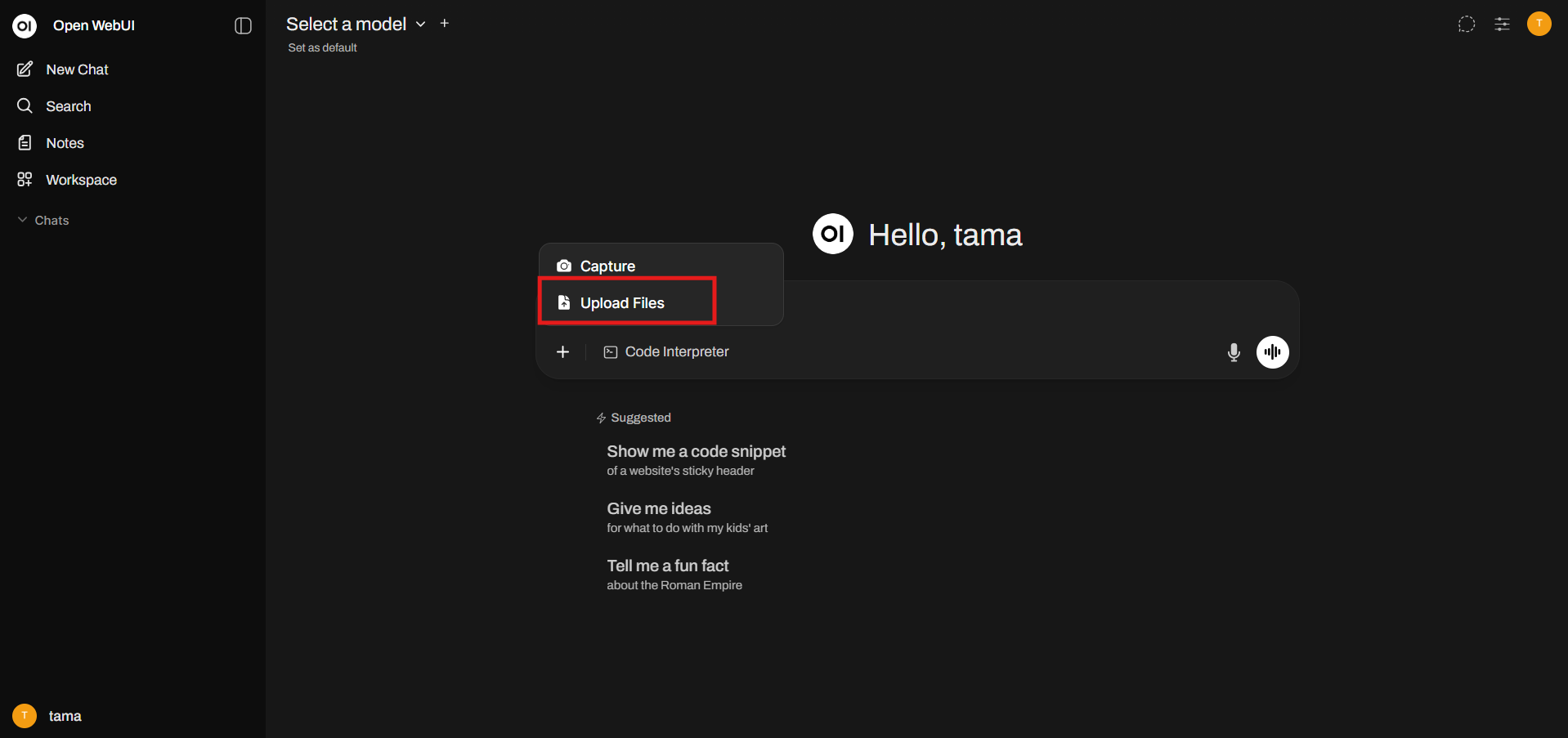

a. Unggah Dokumen

Kamu bisa mengunggah file berformat DOC, PDF, TXT, atau RTF ke dalam obrolan. Caranya:

- Klik tombol + di kolom prompt.

- Pilih Upload Files.

- Unggah dokumen yang diinginkan.

- Tulis instruksi, misalnya:

“Tolong ringkas isi file terlampir dalam 50 kata.”

b. Akses Halaman Web

Jika kamu ingin model menjelajahi di internet, kamu juga bisa mengaktifkan integrasi dengan SearchAPI. Langkah-langkahnya:

- Buka situs resmi SearchAPI dan daftar akun.

- Salin API key dari dashboard.

- Kembali ke Open WebUI > buka Profile > Admin Panel.

- Masuk ke Settings > Web Search.

- Aktifkan Enable Web Search.

- Pilih mesin pencari (misalnya: google, bing, baidu).

- Tempelkan API key yang kamu salin tadi.

- Klik Save.

Setelah diaktifkan, kamu bisa klik tombol + di area chat dan mengaktifkan fitur Web Search. Sekarang kamu bisa menanyakan informasi dari web. Misalnya: “Cari berita terbaru tentang energi terbarukan dan ringkas poin-poin utamanya.”

5. Fitur Kolaborasi dalam Open WebUI

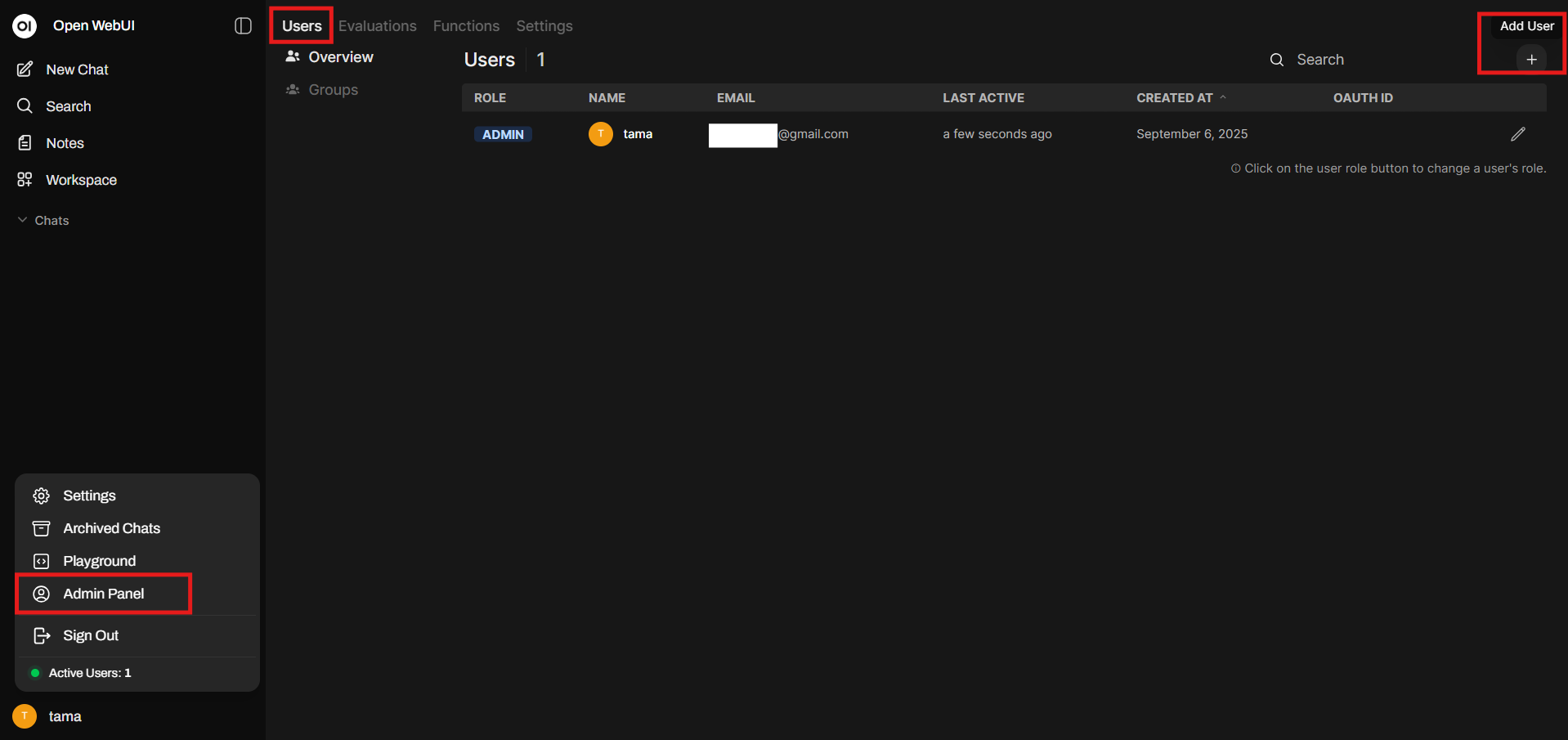

Jika kamu bekerja dalam tim, Open WebUI juga mendukung manajemen untuk multiple users.

a. Menambahkan Pengguna Baru

- Masuk ke Admin Panel > Users > Add User.

- Masukkan nama, email, password, dan peran (admin atau user).

- Bagikan kredensial ke pengguna yang ditambahkan. Catatan: user biasa tidak memiliki akses ke area workspace dan panel admin.

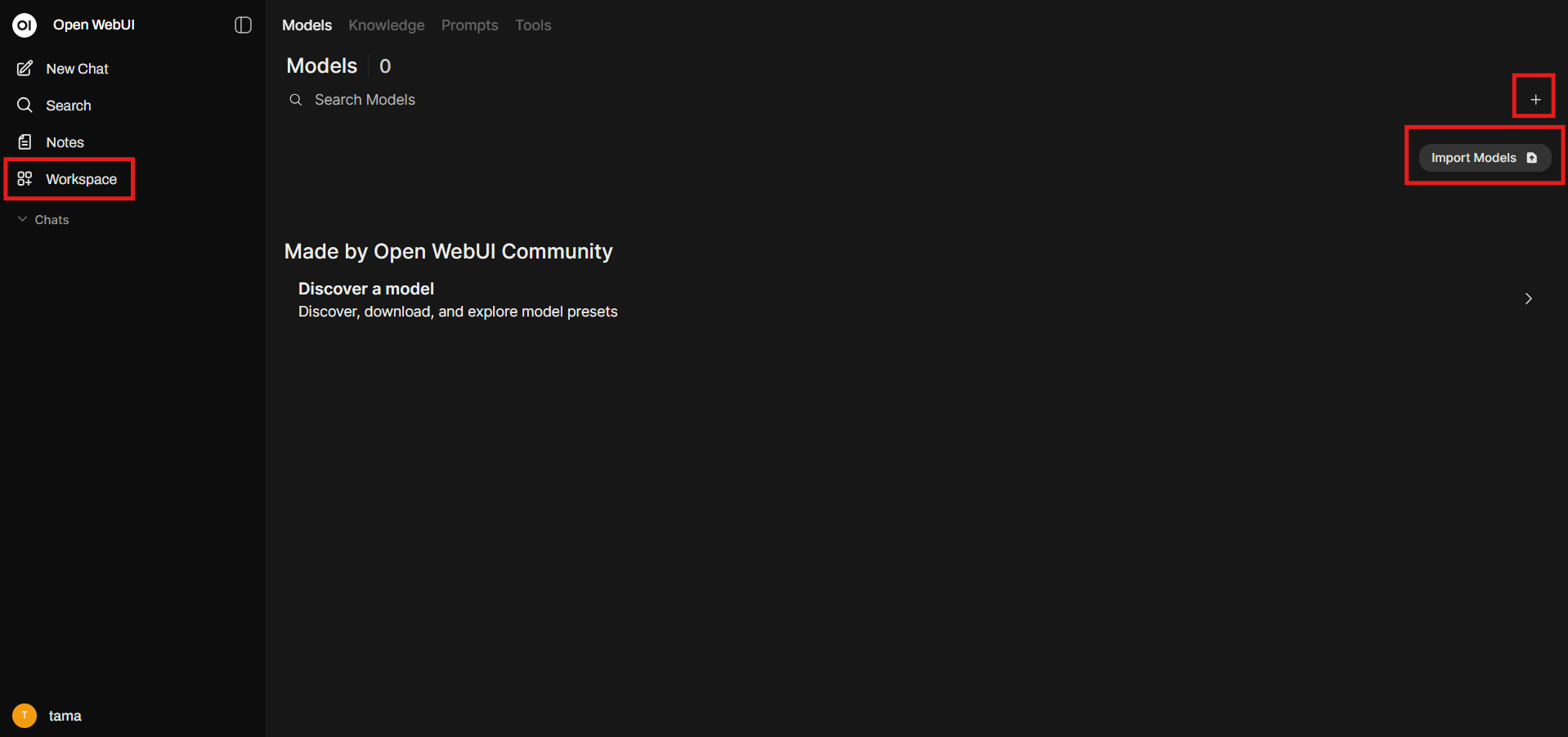

b. Workspace

Buka area workspace dari sidebar kiri. Di tab Models, kamu bisa:

- Membuat model baru dari model yang sudah ada.

- Mengimpor model khusus dari komunitas.

- Menghapus model yang sudah tidak digunakan.

Untuk membuat model kustom, caranya:

- Klik tombol + untuk membuat model baru.

- Isi detail seperti nama, ID, dan model dasar (base model).

- Tambahkan instruksi sistem, contohnya: “Bertindak sebagai penasihat pajak, jangan jawab pertanyaan di luar konteks.”

Kamu juga bisa menambahkan pengaturan lanjutan, saran prompt, serta sumber pengetahuan. Klik Save & Create jika sudah selesai.

Jika belum memiliki dataset, kamu bisa menambahkan di tab Knowledge:

- Klik tombol +.

- Ikuti petunjuk untuk mengimpor dataset.

- Setelah selesai, kembali ke model dan impor knowledge yang tadi kamu tambahkan.

Penyesuaian yang sama juga tersedia di tab Prompts, Tools, dan Functions. Jika belum tahu harus mulai dari mana, kamu bisa mengimpor preset buatan komunitas.

6. Menggunakan Model Multimodal

Terakhir, kita akan membahas model multimodal, yaitu model yang bisa memproses teks sekaligus gambar. Ollama juga mendukung beberapa model multimodal, seperti LlaVa, BakLLaVA, dan MiniCPM-V.

Contoh penggunaannya:

- Unduh model LlaVa dari panel pemilihan model.

- Unggah gambar ke area chat.

- Ketik pertanyaan, misalnya: “Apa isi gambar ini?” atau “Berapa jumlah kucing di gambar ini?”

Model ini bisa memberi deskripsi gambar atau mengenali objek di dalamnya. Tapi perlu dicatat: saat ini LLaVA belum bisa menghasilkan gambar, hanya bisa menganalisis.

Kesimpulan

Menggunakan Ollama dengan Open WebUI memungkinkan kamu menjalankan model AI melalui antarmuka visual yang ramah pemula. Proses instalasinya pun terbilang mudah, bahkan bagi pengguna non-teknis.

Setelah terinstal, kamu bisa menjelajahi dashboard, memilih model, menjalankan prompt, serta mengaktifkan fitur kolaborasi untuk meningkatkan produktivitas. Fitur lanjutan seperti pencarian web dan penyesuaian parameter menjadikan platform ini sangat fleksibel.

Bagi kamu yang ingin membuat model sendiri, kamu bisa mengimpor data pengetahuan, bereksperimen dengan instruksi kustom, serta memanfaatkan preset buatan komunitas.

Nah, kalau kamu ingin langsung mencoba tanpa harus repot, kamu bisa menggunakan Cloud VPS dari DomaiNesia untuk menjalankan Ollama dan Open WebUI. Selain performanya yang cepat dan stabil, Cloud VPS dari DomaiNesia juga menyediakan layanan support penuh 24/7. Jadi, buat kamu yang mengalami kesulitan akses VPS saat menjalankan tutorial di atas, kamu bisa langsung menghubungi tim support dengan cepat.