Cara Terapkan Robots.txt di WordPress, Magento, & Crawler

Hai DomaiNesians! Pada kesempatan kali ini, kita akan membahas secara mendalam tentang Cara Terapkan Robots.txt di WordPress, Magento, & Crawler. Banyak pemilik website yang ingin mengatur akses crawler dengan lebih baik agar website tetap terindeks dengan optimal tanpa membiarkan bot mengakses bagian yang seharusnya tertutup. Panduan ini hadir sebagai solusi praktis untuk menerapkan Robots.txt di WordPress, Magento, serta berbagai skenario crawler lainnya.

Mengapa Butuh Penerapan Robots.txt?

Robots.txt merupakan file teks sederhana yang ditempatkan di root direktori website. File ini berfungsi sebagai panduan bagi crawler mesin pencari dan bot lainnya untuk mengetahui halaman mana yang boleh diakses serta halaman mana yang sebaiknya dihindari. Robots.txt di WordPress sering menjadi salah satu langkah awal penting dalam pengelolaan crawl budget dan pengoptimalan visibilitas di hasil pencarian.

Panduan ini merupakan kelanjutan dari panduan dasar Robots.txt yang telah diterbitkan oleh Domainesia sebelumnya. Pembaca dapat mengakses penjelasan lengkap mengenai fungsi serta sintaks dasar pada tautan berikut: https://www.domainesia.com/panduan/panduan-dasar-robots-txt/. Jika pembaca belum memahami perintah-perintah dasar seperti User-agent, Disallow, Allow, maupun Sitemap, sangat disarankan untuk membaca panduan tersebut terlebih dahulu agar lebih mudah mengikuti pembahasan kali ini.

Panduan ini fokus hanya pada implementasi sederhana Robots.txt di WordPress, Magento, serta beberapa kasus khusus crawler. Kita tidak akan membahas konfigurasi kompleks atau aturan lanjutan yang memerlukan pengetahuan mendalam tentang protokol robots exclusion.

Berikut adalah beberapa skenario ketika penerapan Robots.txt di WordPress, Magento, & Crawler sangat berguna:

- Mencegah crawler mengindeks halaman administrasi atau login yang bersifat pribadi.

- Menghemat crawl budget dengan memblokir halaman duplikat seperti hasil pencarian internal atau halaman filter produk.

- Melindungi halaman staging, preview, atau konten sementara dari indeksasi mesin pencari.

- Mengatur akses berbeda antar bot tertentu, misalnya mengizinkan Google News namun membatasi bot lain.

- Menghindari konten sensitif atau halaman yang belum siap dipublikasikan muncul di hasil pencarian.

Berikut adalah beberapa risiko jika tidak menerapkan Robots.txt di WordPress, Magento, & Crawler dengan benar:

- Crawler menghabiskan waktu pada halaman yang tidak penting sehingga crawl budget terbuang sia-sia.

- Halaman login atau area admin muncul di hasil pencarian sehingga menimbulkan risiko keamanan.

- Konten duplikat atau halaman parameter menyebabkan penalti duplikat dari mesin pencari.

- Website kehilangan kesempatan untuk diindeks secara optimal karena bot terlalu banyak mengakses halaman yang tidak relevan.

- Potensi munculnya halaman error atau preview di indeks pencarian yang merusak pengalaman pengguna.

Panduan ini akan memberikan solusi langsung untuk mengatasi skenario-skenario tersebut melalui penerapan Robots.txt yang tepat.

Struktur Konfigurasi Robots.txt

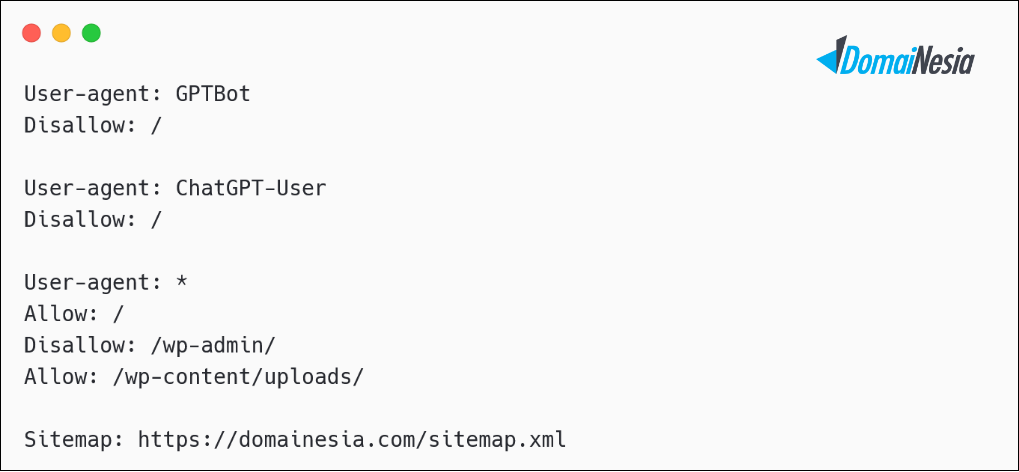

Pada umumnya, file robots.txt memiliki struktur yang terdiri dari beberapa blok aturan. Setiap blok dimulai dengan pernyataan User-agent, diikuti oleh satu atau lebih perintah Disallow atau Allow, serta bisa ditutup dengan lokasi Sitemap jika diperlukan.

Struktur tersebut tidak memiliki urutan baku yang wajib diikuti. Pembaca bebas menukar posisi blok aturan, menambahkan baris baru, atau menghapus baris yang tidak diperlukan sesuai kebutuhan website masing-masing.

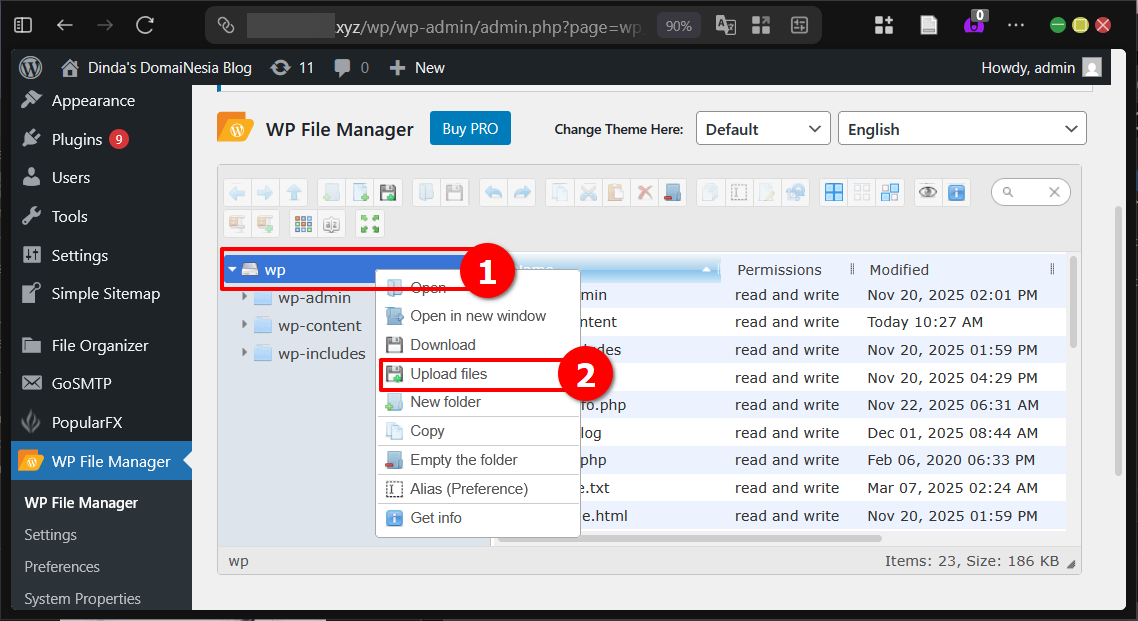

Tambahkan Robots.txt Ke Web

Untuk menambahkan Robots.txt ke web, kita perlu mengakses folder root dari website tersebut melalui file manager hosting atau koneksi SSH/FTP. Di sana, kita dapat mengunggah file bernama robots.txt atau membuat file baru dengan nama tersebut secara langsung.

Jika pembaca menggunakan platform WordPress dan ingin menambahkan Robots.txt dengan cara yang lebih mudah melalui dashboard, pembaca dapat mengikuti panduan khusus dari Domainesia pada tautan berikut: https://www.domainesia.com/panduan/cara-tambahkan-robots-txt-di-wordpress/.

Implementasi Ke Web WordPress

Pada website berbasis WordPress, Robots.txt di WordPress dapat diterapkan dengan menyematkan konfigurasi sederhana berikut di file robots.txt:

|

1 2 3 4 5 6 7 8 9 10 11 12 13 |

User-agent: * Disallow: /wp-admin/ # Blokir akses ke bagian administrasi Disallow: /wp-login.php # Blokir akses ke halaman login admin Disallow: /search/ # Blokir akses ke halaman hasil pencarian internal Disallow: /tag/ # Blokir akses ke halaman arsip tag Disallow: /author/ # Blokir akses ke halaman arsip penulis/author Disallow: /404-error/ # Blokir akses ke halaman error 404 khusus Disallow: *?s=* # Blokir akses ke halaman hasil pencarian internal (parameter s) Disallow: *?p=* # Blokir akses ke halaman dengan parameter p (biasanya ketika permalink gagal) Disallow: *&p=* # Blokir akses ke halaman dengan parameter p tambahan Disallow: *&preview=* # Blokir akses ke halaman pratinjau (preview) Sitemap: https://www.domain-wordpress.com/sitemap_index.xml |

Konfigurasi Robots.txt di WordPress di atas berfungsi untuk melindungi area sensitif seperti dashboard admin serta mencegah indeksasi halaman yang bersifat duplikat atau sementara. Dengan memblokir halaman tersebut, crawl budget lebih terfokus pada konten utama website. Penerapan ini tidak akan merusak SEO selama konten utama tetap diizinkan diakses. Bahkan, hal ini justru membantu meningkatkan kualitas indeksasi karena mesin pencari lebih efisien dalam merayapi halaman yang benar-benar bernilai.

Implementasi Ke Web Magento

Untuk website berbasis Magento, kita dapat menerapkan Robots.txt dengan konfigurasi berikut:

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 |

User-agent: * Disallow: /*?SID= # Blokir semua URL dengan parameter SID (session ID) Disallow: /*?PHPSESSID= # Blokir semua URL dengan parameter PHPSESSID (session ID PHP) Disallow: /catalogsearch/ # Blokir akses ke halaman pencarian katalog Disallow: /search/ # Blokir akses ke halaman pencarian umum Disallow: /customer/account/login/ # Blokir akses ke halaman login pelanggan Disallow: /*?material= # Blokir URL dengan filter material Disallow: /*&material= # Blokir URL dengan filter material tambahan Disallow: /*?price= # Blokir URL dengan filter harga (parameter price) Disallow: /*&price= # Blokir URL dengan filter harga tambahan Disallow: /*?color= # Blokir URL dengan filter warna Disallow: /*&color= # Blokir URL dengan filter warna tambahan Disallow: /*?size= # Blokir URL dengan filter ukuran Disallow: /*&size= # Blokir URL dengan filter ukuran tambahan Sitemap: https://www.domain-magento.com/sitemap_index.xml |

Robots.txt di atas membantu mencegah indeksasi halaman yang mengandung parameter dinamis serta area pribadi pelanggan. Hal ini sangat berguna pada toko online Magento yang memiliki banyak filter produk. Penerapan tersebut tidak berdampak negatif pada SEO asalkan halaman produk utama serta kategori tetap terbuka untuk di-crawl. Malah, konfigurasi ini membantu menjaga crawl budget agar lebih optimal dan mengurangi kemunculan konten duplikat di hasil pencarian.

Kasus Implementasi Lainnya

Selain platform spesifik seperti WordPress dan Magento, terdapat berbagai implementasi Robots.txt yang disesuaikan dengan kebutuhan crawler atau bot tertentu. Berikut merupakan contoh implementasi sederhana yang sering digunakan.

1. Semua Google Bot Larang Akses Kecuali Google News

|

1 2 3 4 5 |

User-agent: googlebot Disallow: / User-agent: googlebot-news Disallow: |

Konfigurasi ini memblokir seluruh akses Googlebot ke website kecuali Googlebot-News yang tetap diizinkan merayapi semua halaman. Fungsinya untuk memastikan hanya konten berita yang muncul di Google News tanpa membiarkan halaman lain diindeks oleh Googlebot biasa.

2. Google dan Slurp Bot Larang Akses

|

1 2 3 |

User-agent: googlebot User-agent: Slurp Disallow: / |

Aturan ini secara tegas melarang Googlebot serta Slurp (bot Yahoo) untuk mengakses seluruh website. Fungsinya biasanya digunakan ketika website ingin menonaktifkan indeksasi sementara dari kedua mesin pencari tersebut.

3. Google dan Slurp Bot Memiliki Akses Yang Berbeda

|

1 2 3 4 5 |

User-agent: Slurp Disallow: /wp-admin-image/ User-agent: googlebot Disallow: /wp-admin/ |

Konfigurasi ini memberikan perlakuan berbeda antar bot. Slurp dilarang mengakses folder wp-admin-image sedangkan Googlebot dilarang mengakses folder wp-admin. Fungsinya untuk mengatur akses secara selektif sesuai kebutuhan keamanan atau konten tertentu.

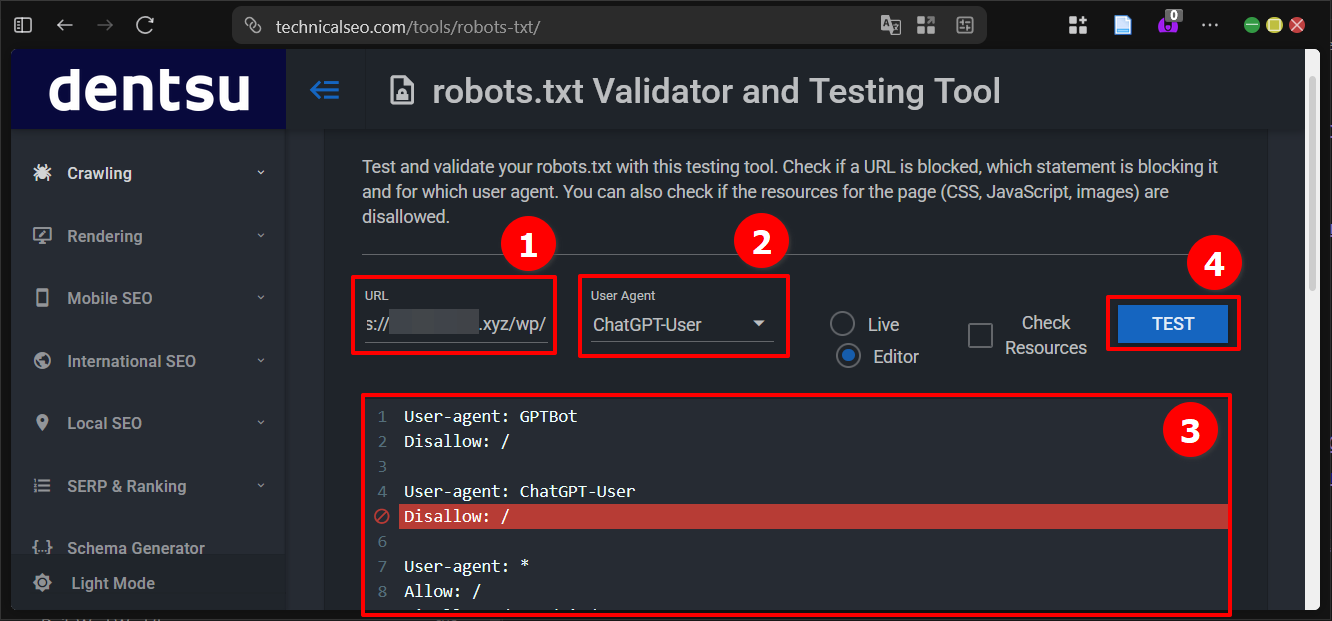

Validasi dan Testing Robots.txt

Setelah memahami cara membuat Robots.txt, langkah penting selanjutnya adalah melakukan validasi agar tidak terjadi kesalahan konfigurasi yang justru merugikan website.

Pembaca dapat menggunakan alat validasi Robots.txt secara online yang tersedia di technicalseo.com/tools/robots-txt/.

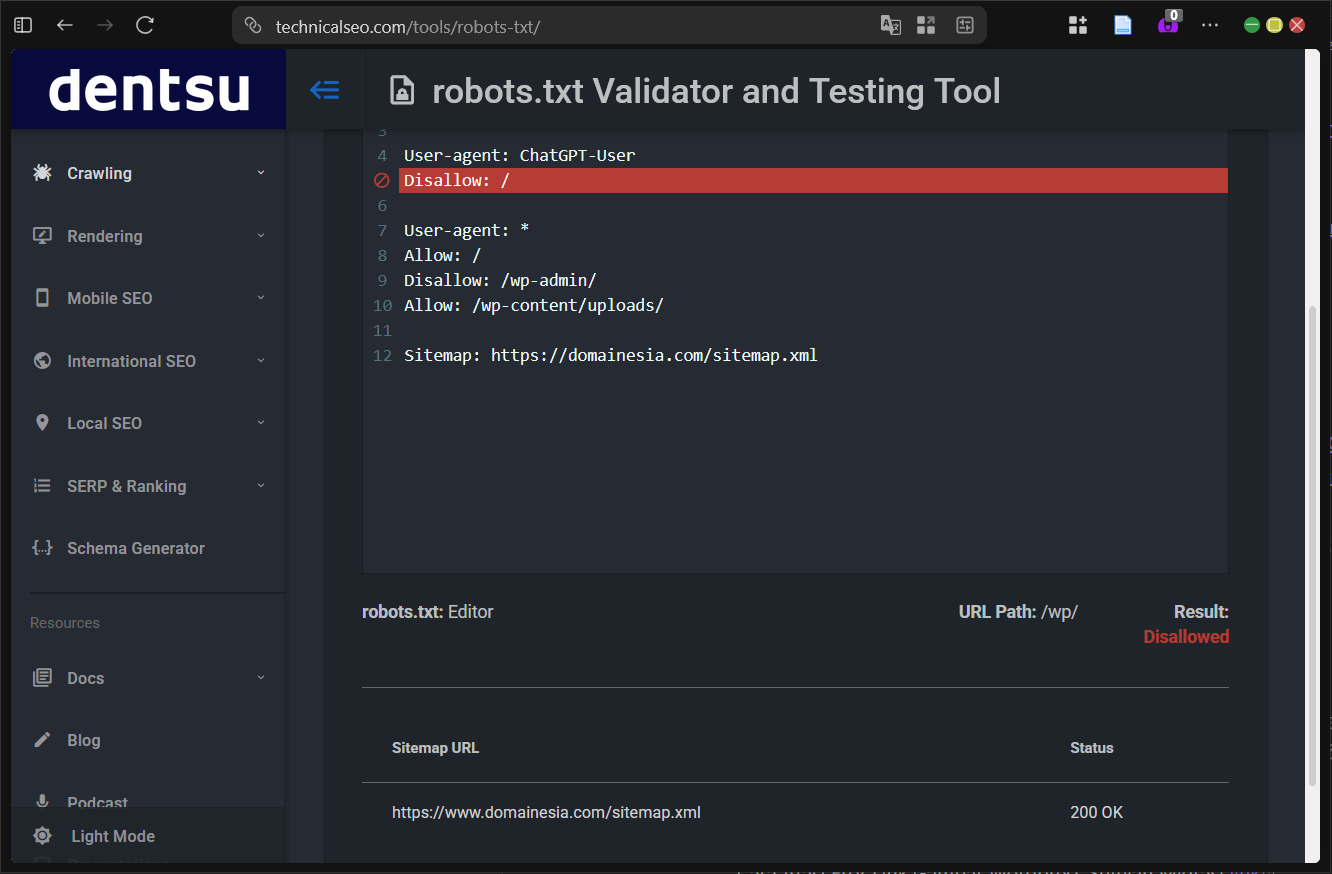

Pada website tersebut, pembaca bisa langsung menulis atau menempelkan struktur Robots.txt yang telah dibuat. Selanjutnya, masukkan URL contoh pada kolom yang disediakan untuk menguji apakah aturan tersebut berfungsi sesuai harapan.

Hasil pengujian akan muncul setelah pembaca mengklik tombol “Test”. Alat ini akan menjelaskan apakah URL tertentu diizinkan atau dilarang berdasarkan aturan yang dibuat.

Setelah pengujian dinyatakan berhasil dan tidak ada konflik aturan, pembaca dapat segera mengunggah file Robots.txt ke root direktori website.

Jadi Lebih Tahu Tentang Robots.txt!

Kita telah membahas secara lengkap mulai dari alasan pentingnya menerapkan Robots.txt, struktur dasar file tersebut, cara menambahkannya ke website, hingga implementasi khusus pada WordPress, Magento, serta beberapa kasus crawler lainnya. Robots.txt di WordPress dan platform lain menjadi alat sederhana namun sangat efektif untuk mengatur crawl behavior, menghemat sumber daya server, serta menjaga kualitas indeksasi. Dengan memahami dan menerapkan aturan ini secara tepat, website akan lebih terkontrol dan berpotensi tampil lebih baik di mesin pencari.

Selamat DomaiNesians! semoga pengetahuan tentang Robots.txt di WordPress serta penerapannya di berbagai platform dapat langsung diterapkan pada website masing-masing. Sampai jumpa di artikel dan panduan DomaiNesia berikutnya!